Attention机制

什么是注意力?

不论是前几年在人工智能的各个领域大放异彩的Attention机制(首先在机器翻译任务[1]中取得成功,后逐渐被计算机视觉[2]等众多领域采用)还是最近掀起自然语言处理领域革命的Self-Attention机制[3],注意力在人工智能领域的成功不仅证明了从人类大脑的角度出发寻找机制来解决人工智能问题的可行性(无论最初将Attention机制引入人工智能领域的学者是否真的是受脑启发而想到的idea,但从结果和现象上来说,人工智能中使用的Attention机制与大脑中的注意力有惊人的相似之处),深度学习的发展也在一定程度上可以帮助我们对大脑进行更多可能的想象。

说了这么多,那么我们大脑中的注意力到底是什么呢?在学习脑科学以前,我从来没有察觉到我们每时每刻可以觉知的信息竟然这么少,就拿视觉来说,之前我总认为我可以一眼把整个场景中的信息全部得到,但后来我才发现,如果没有眼动,我们在看书时一次能够注意到的信息也就是五到十个字,我们明明感觉所有的信息都被我们接收了,但为什么我们能感知到的信息仅有这么一点点呢?其实我们有意觉知到的内容只是我们感觉系统每时每刻获得的海量信息中很少的一部分,那么大脑又是如何舍弃一些信息而选择另外一些信息的呢?这其中就涉及到了注意力的影响。

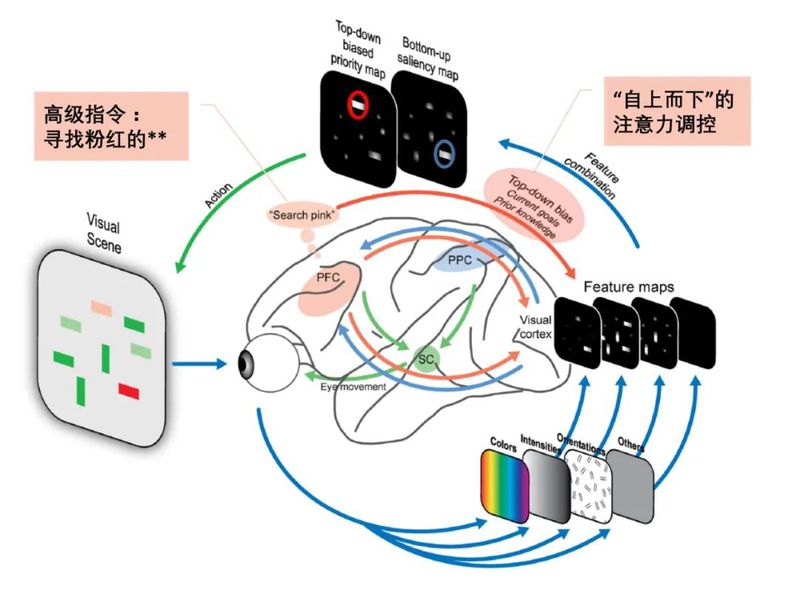

我们大脑中的注意力既包括自上而下(有意的)的目标驱动的过程,又包括自下而上(反射性的)的刺激驱动的过程(如下图所示)。而且这两种机制处于一种动态竞争中,争夺着我们对当前注意焦点的控制。有意注意作为一种自上而下的、目标驱动的过程,对应着我们有意地注意一些东西的能力,让我们能够加工与当前情境或任务相关的输入、思想或行为,而忽视与当前任务无关或引人分心的刺激。而反射性注意作为一种自下而上的、刺激驱动的过程,即一个感觉事件捕获了我们的注意,例如当我们上课时如果教室的门半开着,而当课程上到一半时,门外有人走过,我们的头会不自觉的转向门的方向,过一会再转回课堂上。注意力的存在表明我们没有能力加工施加在我们感觉器官上的所有信息,并对其做出反应,而且我们也不需要这种覆盖一切的加工,特别是当我们身边充斥着大量影像和声音的时候。

图片来自:https://www.zhihu.com/question/33183603/answer/150792028

注意力发生在什么阶段呢?

既然我们可以选择性的感知自己感兴趣的信号,那么这一过程是发生在知觉加工流程中的什么位置呢?是否存在某些仅允许部分信息获得加工的门控机制?这种门控存在于视觉加工过程的哪一位置呢?

根据加工位置的不同可以分为早选择模型和晚选择模型。早选择模型的理论认为,被选择进入更高的层次加工或作为无关信息被拒绝前,刺激不需要经过完全的知觉加工。但随后发现的一些实验现象与该理论不符:当包含对于被试具有高优先性的信息时,即使在非注意耳,也能捕获注意,比如当自己的名字被呈现在非注意耳时。非注意输入的侵入这一现象使得人们认为所有信息都获得了加工,无论它们在随后的加工中是被注意或是被忽视的。晚选择模型假设被注意的和被忽视的感觉输入都同等地被知觉系统加工,直到获得语义水平的编码和分析。

但也可能非注意通道的信息并不是彻底被阻挡在更高水平的加工之外,而是仅仅退化或被削弱了。如果非注意耳的信息达到了足够高的加工阶段,使其获得语义或类别性编码(例如,作为“椅子”,而不是仅仅体现为椅子的低水平感觉特征在视觉系统所引发的神经元反应),它们就有可能导致注意在语义编码的加工水平完成之后选择到非注意耳的输入上去,从而让这些信息能够进入觉知。

参考文献

[1]Luong, M. T., Pham, H., & Manning, C. D. (2015). Effective approaches to attention-based neural machine translation. arXiv preprint arXiv:1508.04025.

[2] Anderson, P., He, X., Buehler, C., Teney, D., Johnson, M., Gould, S., & Zhang, L. (2018). Bottom-up and top-down attention for image captioning and visual question answering. In Proceedings of the IEEE conference on computer vision and pattern recognition (pp. 6077-6086).

[3] Vaswani, A., Shazeer, N., Parmar, N., Uszkoreit, J., Jones, L., Gomez, A. N., ... & Polosukhin, I. (2017). Attention is all you need. In Advances in neural information processing systems (pp. 5998-6008).

[4]封面图片来自知乎:

https://www.zhihu.com/question/33183603/answer/150792028

本次我们主要讨论了什么是注意力,以及注意力发生在我们信息处理过程的哪个阶段,下一次我们将会讨论大脑注意后对刺激产生的影响以及注意力机制在人工智能领域的应用。

本文为原创文章,请勿抄袭、粘贴式转载!